La tecnologia Rekognition messa a punto da Amazon finisce al centro di una nuova discussione, dopo che nei mesi scorsi centinaia di dipendenti del gruppo hanno manifestato preoccupazioni legate a un suo impiego a livello governativo. Questa volta se ne parla in relazione a uno studio condotto dal Media Lab del Massachusetts Institute of Technology che ne contesta l’efficacia e la precisione.

Il riconoscimento facciale di Rekognition

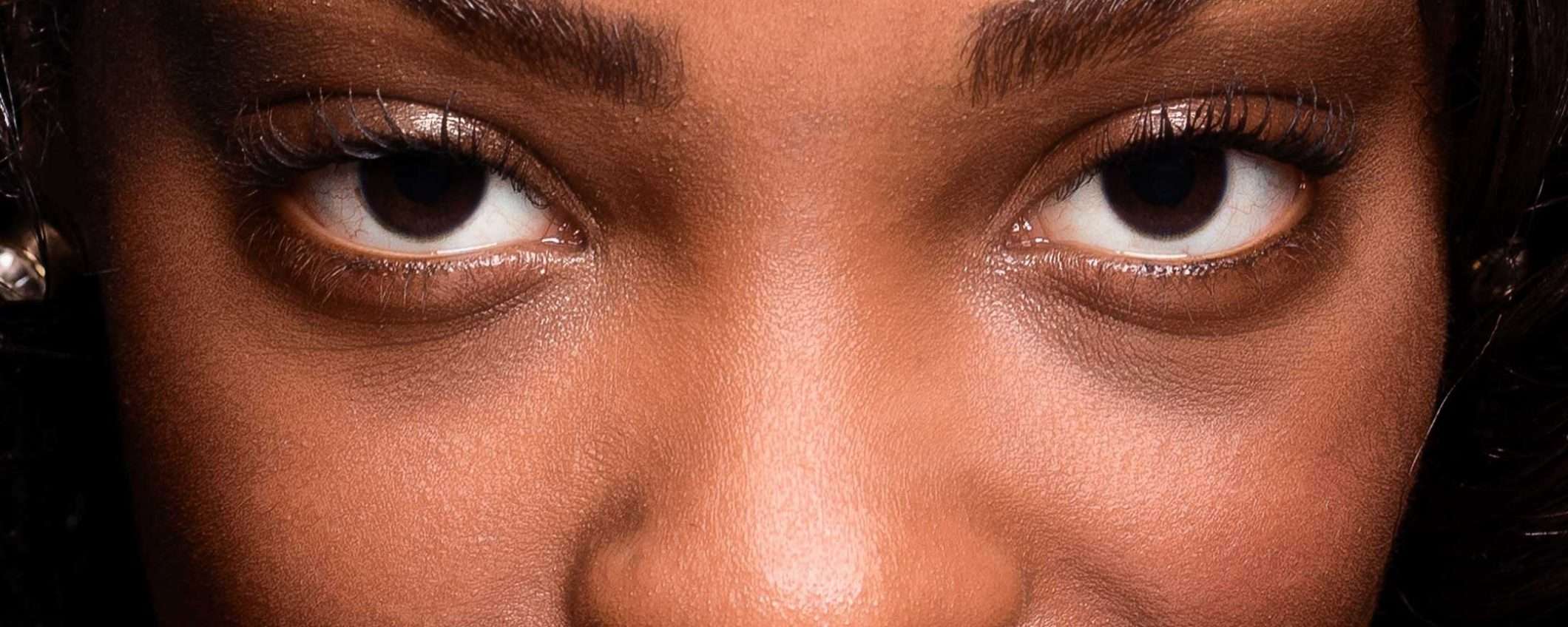

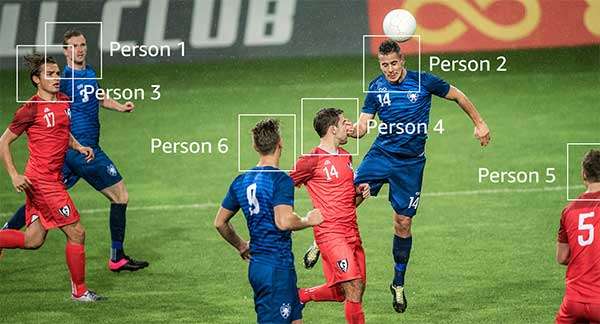

Per chi non ne fosse a conoscenza, si tratta di una soluzione per il riconoscimento facciale, presentata ormai quasi due anni fa dalla divisione Web Services del colosso di Seattle. Fa affidamento ad algoritmi di intelligenza artificiale per identificare le persone (e gli oggetti) presenti in una fotografia o nei fotogrammi di un video. Da una delle immagini incluse nella pagina AWS che illustra il servizio, allegata di seguito, si apprende come la tecnologia sia in grado di definire il sesso, caratteristiche come la presenza di un sorriso e l’apertura degli occhi, valutando di conseguenza lo stato d’animo del soggetto.

I risultati della ricerca condotta dal MIT saranno presentati all’inizio della prossima settimana in occasione della conferenza AIES (Artificial Intelligence, Ethics and Society) di Honolulu. Parlano di un comportamento degli algoritmi che durante i test non ha restituito errori nel valutare il genere degli individui di sesso maschile e con pelle chiara. Il 19% delle immagini raffiguranti una donna ha invece restituito un esito non corretto (sono state etichettate come uomini), una percentuale che cresce fino al 31% per le donne con pelle scura.

Confrontando l’esito della prova con quello ottenuto dalla tecnologia concorrente di Microsoft, quest’ultima è inciampata nello stesso problema solo nell’1,5% dei casi. Per il software messo a punto dalla startup californiana Kairos la percentuale di errore è del 22,5%. Altri player che offrono prodotti alternativi sono IBM e la cinese Megvii con il suo Face++. Google ha deciso di non proporre soluzioni commerciali di questo tipo prima di definire una policy sul tema.

Per Matt Wood, General Manager del team Artificial Intelligence di Amazon Web Services, il documento frutto dello studio si basa su una premessa sbagliata e la sua conclusione può essere considerata fuorviante: i ricercatori hanno preso in esame solo le abilità di analisi facciale (l’individuazione di caratteristiche come i baffi o le espressioni del viso) e non il riconoscimento facciale la cui finalità è invece quella di identificare i soggetti.

IA, governo e privacy

A preoccupare ancor più della precisione degli algoritmi (che inevitabilmente andrà migliorando col tempo) è però un’altra questione, quella riguardante le modalità di impiego delle tecnologie. Nel caso di Amazon, non è chiaro quali agenzie federali statunitensi stiano già facendo uso di Rekognition nello svolgimento di indagini e operazioni il cui obiettivo ufficiale è quello di garantire la sicurezza della collettività. Di certo l’FBI ne ha messo alla prova le capacità attraverso una fase di test.

C’è chi vi intravede un pericolo per la privacy, poiché al momento non esiste una normativa strutturata in modo da regolamentare l’utilizzo di sistemi IA in grado di identificare i soggetti, anche in contesti affollati. Una minaccia che ha più probabilità di prendere forma se servizi e sistemi di questo tipo vengono liberamente offerti sul mercato a realtà private che nel peggiore dei casi vi possono far leva per raccogliere dati e informazioni in modo indiscriminato. Si pensi ad esempio alle conseguenze di una loro integrazione in prodotti come droni o videocamere per la sorveglianza.

Come sempre sottolineiamo parlando di questi temi, Rekognition e i suoi competitor sono tecnologie e in quanto tali possono essere definiti come strumenti, neutrali per natura e definizione. A conferir loro un valore positivo o negativo è l’uso che se ne fa. Per questo in molti, compresi alcuni esponenti della politica d’oltreoceano, chiedono a gran voce di colmare al più presto l’attuale gap legislativo affinché si possa beneficiare di un’applicazione corretta e rispettosa dell’intelligenza artificiale, scongiurando al tempo stesso il rischio di abusi o impieghi malevoli. Una volontà ben riassunta dalle parole di Edward J. Markey, senatore democratico già attivo in un’indagine su Rekognition.

Tecnologie come Amazon Rekognition dovrebbero essere utilizzate se e solo se conformi a valori americani come il diritto alla privacy. Non penso che questo requisito sia al momento soddisfatto.