Meta ha annunciato un nuovo tool che consente di generare musica e audio di alta qualità sfruttando l’intelligenza artificiale. Si chiama AudioCraft ed è open source, quindi gli sviluppatori possono esaminare il codice sorgente pubblicato su GitHub. Il funzionamento è simile a quello di Google MusicLM.

Meta AudioCraft: musica con l’IA, da input testuale

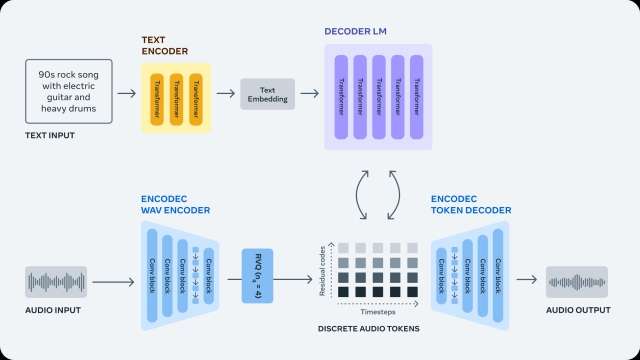

AudioCraft è basato su tre modelli IA: MusicGen, AudioGen e EnCodec. MusicGen, addestrato con musica di Meta e altra protetta da diritto d’autore, genera musica da un prompt di testo. AudioGen, addestrato con effetti audio pubblici, genera audio da un prompt di testo. L’azienda di Menlo Park ha inoltre rilasciato una versione migliorata di EnCodec, un decoder che permette di generare musica a qualità maggiore e con meno artefatti.

Il gruppo ha inoltre rilasciato modelli AudioGen pre-addestrati che consentono di generare suoni ambientali e particolari effetti sonori, ad esempio un cane che abbaia, il clacson di un’auto o il rumore di passi su un pavimento di legno. Utilizzando il codice sorgente è possibile addestrare i modelli con i propri dati.

La società di Mark Zuckerberg sottolinea che la generazione di audio e musica in alta qualità è un’operazione più articolata rispetto alla generazione di testo, immagini e video. Esistono altri progetti, ma sono complessi e spesso “closed source”. Nella seguente immagine è visibile la sequenza di passi che porta dall’input testuale all’output sonoro.

Gli utenti possono ascoltare l’audio generato dal modello AudioGen in questa pagina. La demo del modello MusicGen permette invece di generare musica a partire dal testo (in inglese), eventualmente caricando una melodia da file o tramite microfono. Meta ritiene che MusicGen possa diventare un nuovo tipo di strumento, come avvenuto con i sintetizzatori oltre 60 anni fa.