Sin da quando ChatGPT è diventato il fenomeno del momento, sia per gli amanti della tecnologia che per coloro che non possono ritenersi veri esperti in materia, sono emerse preoccupazioni in merito ai suoi rischi lato cybersecurity e anche sul fronte privacy, ovvero sulla protezione dei dati degli utenti che provano il servizio. OpenAI, infatti, raccoglie continuamente informazioni dalle conversazioni che si intrattengono con il chatbot al fine di migliorarlo.

Proprio per questa ragione ChatGPT è stato bloccato in Italia lo scorso marzo, con un provvedimento temporaneo che ha indignato anche i governi di altri stati europei, in virtù dell’assenza di sistemi per la verifica dell’età e della manifestazione di alcuni dubbi sulla raccolta dei dati personali. Pure oltre il Belpaese, però, ora il chatbot di Sam Altman e soci è finito nel mirino degli analisti in quanto viene addestrato sulle informazioni condivise dal pubblico. Fortunatamente, esiste già un modo per controllare i propri dati ed eventualmente cancellare il proprio profilo su ChatGPT.

Problemi di privacy

Man mano che le persone sperimentano l’utilizzo del chatbot, i problemi di quest’ultimo diventano sempre più evidenti: la creazione di contenuti falsi è il primo, tra falsi articoli di giornale che parlano del decesso di attori, oppure la generazione di conversazioni finte che diffamano autorità o istituzioni senza alcuna fonte autorevole. I cittadini e le aziende stanno diventando sempre più timorose: ChatGPT come usa i nostri dati per fornire output potenzialmente pericolosi?

Samsung ha già deciso di intervenire in merito, poiché non è solo la privacy degli utenti ad essere a rischio: a inizio maggio 2023 il gigante sudcoreano ha vietato ai dipendenti di utilizzare strumenti di intelligenza artificiale generativa, in quanto l’archiviazione di documenti sensibili e segreti aziendali su server esterni potrebbe portare al leak di dati riservati.

Nel mentre, OpenAI ha ribadito che il suo modello di linguaggio viene addestrato grazie a tre fonti principali: i dati presi dal Web fino al 2021, alla base di GPT-4; i dati ottenuti in licenza da altre aziende; e le informazioni che le persone gli forniscono tramite chat, comprese quelle più personali. L’organizzazione stessa spiega che una grande quantità dei dati disponibili pubblicamente su Internet si riferisce alle persone; ergo, possono includere incidentalmente dettagli più sensibili.

La soluzione per ChatGPT

Oltre a queste dichiarazioni, però, arriva anche la soluzione effettiva: OpenAI ha reso disponibile un modulo di richiesta di rimozione dei dati personali che consente agli utenti di rimuovere le loro informazioni dai sistemi proprietari. Tale form compilabile online richiede l’inserimento di dati come nome e cognome, e-mail, Paese in cui ci si trova e natura del soggetto ai quali si riferiscono i dati presumibilmente presenti nei server di ChatGPT. Serve, oltretutto, una lista di prompt che portano effettivamente alla generazione di output riguardanti tale individuo. Infine, la società afferma che bilancerà “privacy e libera espressione” quando prenderà decisioni sulle richieste di cancellazione delle persone, assicurando l’eliminazione effettiva delle informazioni – seppur non in tutti i casi.

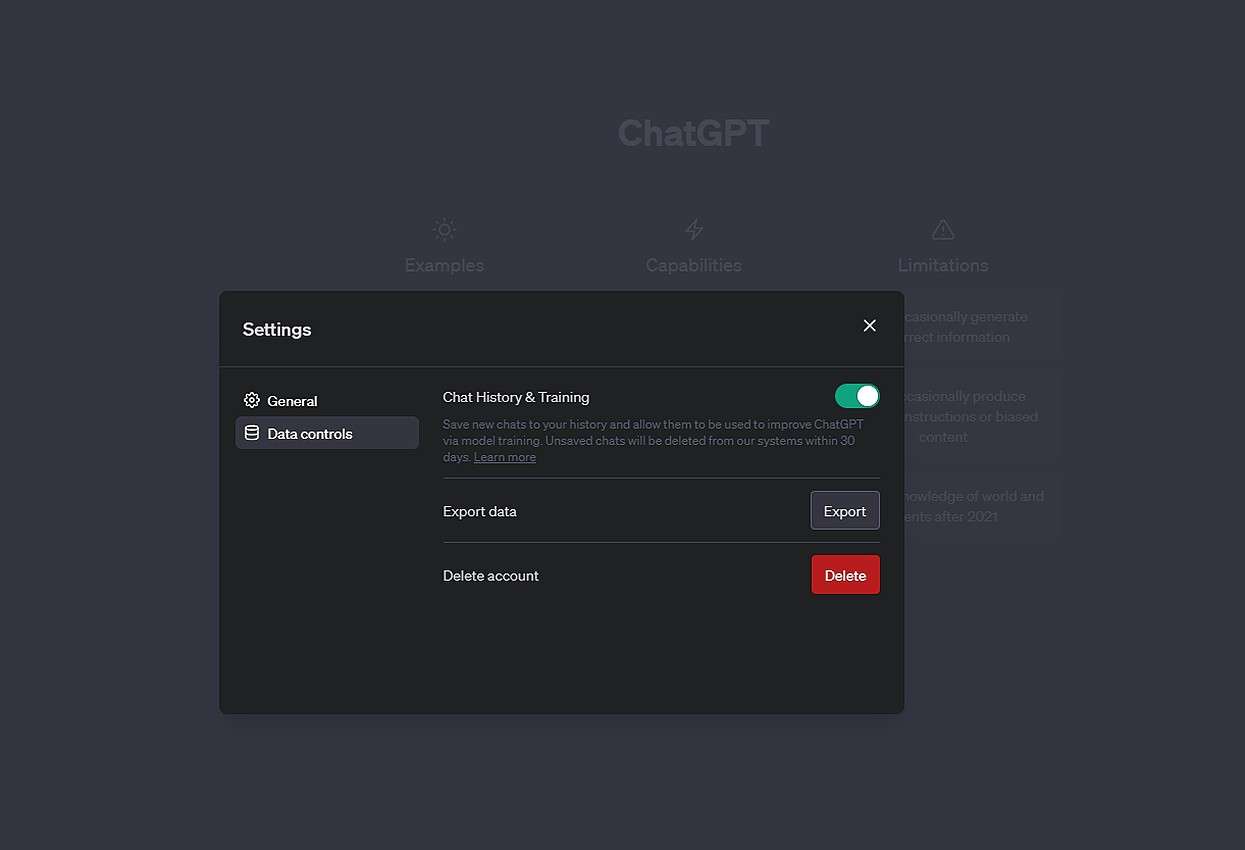

In aggiunta, OpenAI consente l’eliminazione dello storico delle conversazioni, ma non in via retroattiva, tramite le impostazioni di ChatGPT: come potete vedere sopra, basta disattivare l’interruttore “Chat History & Training” affinché i server non salvino le chat e le utilizzino per migliorare il modello di linguaggio addestrandolo ulteriormente. Naturalmente, rimane possibile l’esportazione dei dati e la cancellazione completa dell’account.