L’intelligenza artificiale può migliorare e supportare lo svolgimento di alcune attività, rendendole più rapide e produttive. Questo ha portato allo sviluppo di diverse piattaforme, tra cui ChatGPT, sicuramente l’innovazione più interessante degli ultimi tempi. Tuttavia, non tutto è perfetto, ChatGPT presenta delle carenze, che probabilmente potranno essere risolte nel tempo, ma per ora analizziamo i problemi principali di ChatGPT.

- ChatGPT: il chatbot intelligente

- ChatGPT: non solo innovazione

- ChatGPT in dubbio la qualità dei contenuti

- Trasparenza e addestramento

- Discriminazione da parte di ChatGPT

- Privacy: gli utenti di ChatGPT in pericolo

- Rapida accessibilità = massimo danno

- L’evoluzione dei posti di lavoro

- ChatGPT mette alla prova l’istruzione

- Lotta per il potere

ChatGPT: il chatbot intelligente

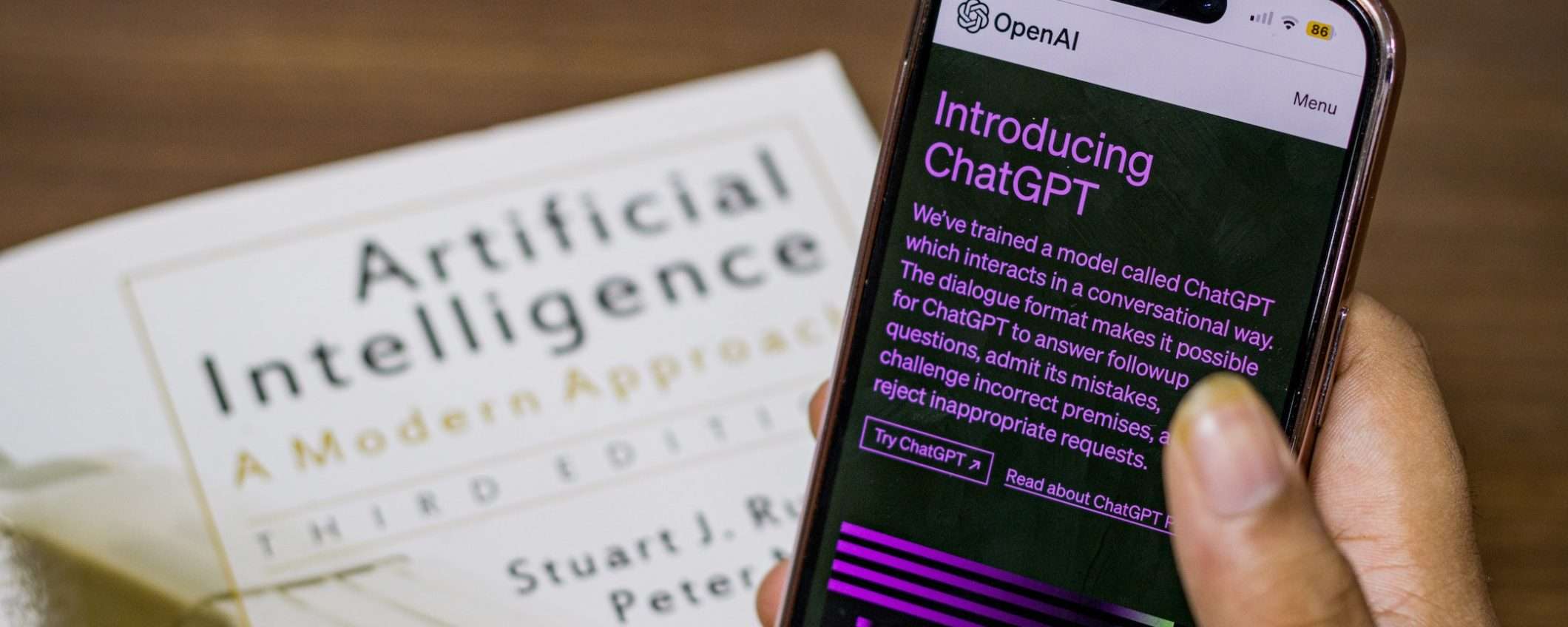

ChatGPT, sviluppato da OpenAI, si basa su GPT-4, il modello di linguaggio naturale più avanzato al mondo, che ha accesso a Internet e può apprendere da una vasta quantità di dati. ChatGPT è in grado di rispondere a una seria di input e può generare contenuti per ogni scopo. ChatGPT sembra essere quindi l’assistente intelligente perfetto e innovativo, purtroppo non è così, ChatGPT presenta alcuni grossi problemi, che ne limitano l’efficacia, l’affidabilità e l’etica.

ChatGPT: non solo innovazione

ChatGPT è un chatbot molto potente e utile, ma anche problematico. Infatti, per usare ChatGPT in modo responsabile e consapevole è importante essere informati su tutti gli aspetti, positivi e negativi, del chatbot e capire che può generare moltissimi contenuti ma rimane un chatbot che non può sostituire l’essere umano. I suoi limiti ci sono e sono vari come la qualità, la sicurezza, la privacy, l’autenticità, la proprietà, l’accessibilità, la sostenibilità e la trasparenza.

ChatGPT in dubbio la qualità dei contenuti

ChatGPT non sempre genera contenuti di qualità, ma spesso produce contenuti irrilevanti, incoerenti, ripetitivi o errati. Questo dipende dal fatto che ChatGPT non ha una vera comprensione del significato dei contenuti che genera. Infatti, spesso non rispetta la proprietà dei contenuti che genera, violando così i diritti d’autore. Inoltre, non sempre le risposte generate sono giuste, al contrario commette molti errori e risponde in modo del tutto errato ad alcuni input, divulgando così informazioni false e di scarsa qualità.

Trasparenza e addestramento

La sicurezza è un altro problema di ChatGPT, che può generare contenuti nocivi, offensivi, discriminatori o illegali. Anche se OpenAI ha migliorato le sue politiche sulla privacy dopo una violazione dei dati, potrebbe non essere sufficiente per rispettare il Regolamento generale sulla protezione dei dati, la legge sulla protezione dei dati che riguarda l’Europa. I dati di addestramento di OpenAI non sono pubblici, questo porta ad una mancanza di trasparenze e innesca dubbi sulla qualità dell’addestramento del chatbot. Infatti, ancora oggi non sono conosciuti i dati di addestramento usati, da dove provengono o come sia strutturato il sistema in dettaglio.

Discriminazione da parte di ChatGPT

ChatGPT non garantisce sempre la trasparenza dei contenuti che genera, ma talvolta crea dei contenuti oscuri, ambigui o nascosti. ChatGPT è stato addestrato sulla scrittura collettiva degli esseri umani in tutto il mondo, passato e presente. Purtroppo, ciò significa che gli stessi pregiudizi nel mondo reale possono riflettersi anche nel modello.

È stato dimostrato che ChatGPT produce alcune risposte che discriminano genere, razza e gruppi minoritari, cosa che l’azienda sta cercando di mitigare. OpenAI è consapevole di questo problema e ha dichiarato che sta affrontando il “comportamento parziale” raccogliendo feedback dagli utenti e incoraggiandoli a segnalare gli output ChatGPT che sono cattivi, offensivi o semplicemente errati.

Privacy: gli utenti di ChatGPT in pericolo

La condivisione dei dati personali sul web comporta già di per sé un rischio elevato, ma la condivisione con i chatbot AI lo aumenta ulteriormente. In passato si sono verificati più volte dei casi di violazione della sicurezza che hanno arrecato dei danni agli utenti, con la diffusione di informazioni personali nelle chat di varie piattaforme. Questo ha portato, per un periodo di tempo, alla sospensione del Chatbot in Italia con la richiesta di interrompere l’elaborazione dei dati degli utenti. Per soddisfare le richieste di legge OpenAI ha apportato diverse modifiche significative, tra queste:

- Limitare l’uso dell’app a persone di età superiore ai 18;

- L’utilizzo per i 13 anni con il permesso del tutore;

- Informativa sulla privacy più visibile;

- Inserimento del modulo di disattivazione di Google per escludere i propri dati dalla formazione;

- Possibilità di eliminare la cronologia ChatGPT.

Rapida accessibilità = massimo danno

La rapidità di accesso e la velocità con cui può produrre informazioni può comportare diversi problemi, soprattutto se viene usato con scopi non etici. Non è d’aiuto neanche la diffusione di ChatGPT di informazioni false. Per questi motivi la scala con cui ChatGPT può produrre testo, unita alla capacità di rendere credibili anche le informazioni errate, rende tutto ciò che si trova su Internet dubitabile. È una combinazione pericolosa che amplifica i rischi della tecnologia deepfake.

L’evoluzione dei posti di lavoro

I cambiamenti tecnologici hanno sempre portato alla perdita di posti di lavoro, ma la rapidità dei progressi dell’intelligenza artificiale implica che molti settori si confrontano con trasformazioni rapide. Sfortunatamente, questo sviluppo così rapido potrebbe accelerare le cose in modo errato, in quanto spinge i datori di lavoro a sostituire determinate attività con l’intelligenza artificiale, ma essendo in fase di sviluppo potrebbe danneggiare i lavoratori e le aziende. La potenza di ChatGPT e l’intelligenza artificiale in sé potrebbero determinare un cambiamento totale per alcune aree di lavoro, ed è giusto così, ma serve del tempo.

ChatGPT mette alla prova l’istruzione

ChatGPT è entrato a far parte della vita di molti utenti, il rischio non è solo per il lavoro, ma anche per lo studio. Infatti, in breve tempo sarà parte integrante anche delle scuole, ma soprattutto diventerà il supporto ufficiale per gli studenti. Anche in questo caso il problema principale è sempre la qualità dei contenuti, ma soprattutto il rischio di rendere lo studente completamente dipendente da ChatGPT, in quanto il chatbot può aiutare con qualsiasi attività. Questo è un campanello d’allarme importante, perché le scuole e le università dovranno aggiornare le loro politiche e decidere se gli studenti possano o meno utilizzare l’intelligenza artificiale in un compito o in un progetto.

Lotta per il potere

Lo sviluppo di ChatGPT non si ferma, al contrario la popolarità di ChatGPT ha stimolato una vera corsa al potete. Tutte le grandi aziende tecnologiche sono in competizione per lanciare il prossimo grande modello di intelligenza artificiale. Ma questo, porta a un rapido sviluppo dei relativi servizi che può portare a seri problemi di sicurezza. In ogni caso OpenAI non sembra intenzionato a rallentare, in quanto azienda privata seleziona i dati utilizzati per addestrare ChatGPT e sceglie la velocità con cui implementare i nuovi sviluppi. Per questo è necessario sensibilizzare gli utenti a utilizzare il chatbot in modo sicuro e soprattutto per scopi etici. Ricordando, come detto in precedenza, che i contenuti generati dall’AI non sono sempre del tutto affidabili, per questo è necessario fare una verifica approfondita sull’informazioni apprese.