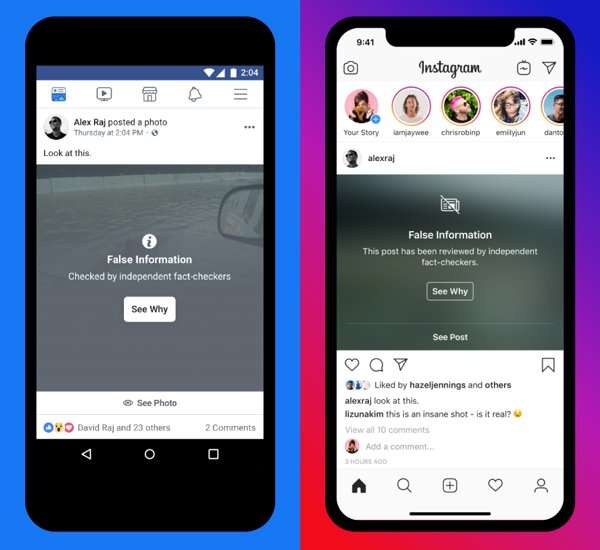

Come preservare la libertà di espressione pur limitando la viralità del falso? Di fronte a questo dilemma si scontra il diritto/dovere di Facebook di confermarsi come punto di riferimento per il social networking pur senza abdicare alle proprie responsabilità. La scelta è quella della divulgazione informata, affiancando le notizie ad appositi flag che vadano a sottolineare la natura del contenuto che si sta per osservare. Così come succede con le immagini violente, insomma, un sistema di offuscamento renderà evidente ciò che è falso affinché il click, la lettura e la credulità possano essere una libera scelta.

Facebook e Instagram: evidenziamo il falso

L’annuncio giunge all’interno di un comunicato che snocciola tutte le novità previste da Facebook in vista della prossima temuta tornata elettorale USA, laddove la piattaforma social avrà giocoforza ruolo centrale nella divulgazione di propaganda e informazione politica. Per questo specifico ambito, e soprattutto in relazione agli account delle persone coinvolte nella campagna elettorale, sono previste regole e tutele specifiche. In parallelo, però, non si darà adito al falsari di divulgare informazione che inquini i pozzi del social networking. Come? Facendo leva sul fact-checking.

Quando appositi riferimenti del fact-checking stabiliscono che una notizia è falsa, la sua diffusione sarà rallentata togliendovi visibilità sul network. Non sarà cancellata, dunque, ma limitata. Ma non solo. Questo processo, infatti, rallenta l’elemento algoritmico della viralità, ma non ha presa sull’elemento umano: migliaia di condivisioni potrebbero comunque rendere popolare una notizia falsa o calunniosa. Ecco perché Facebook aggiungerà un layer che maschera l’immagine avvertendo l’utente che sta andando incontro a qualcosa per cui la sentenza di falso è già stata pronunciata.

Attenzione, dunque: stai per leggere una fake news! Sicuro di voler proseguire?

La bontà di questa procedura sta però in un elemento ulteriore: non solo la notizia viene etichettata come falsa, ma è disponibile anche la spiegazione breve dei fact-checker in caso di tentativo di condivisione. Insomma: se condividi questa notizia, sappi che è falsa e i motivi sono espliciti. A questo punto la scelta dei singoli rimane possibile e chiunque è libero di condividere una notizia falsa, ma a questo punto non potrà sostenere che fosse verosimile, che ci sia stata confusione o cos’altro: l’utente avrà di fronte a sé tutti gli elementi per sapere, informarsi, capire e decidere.

Le notizie probabilmente false (Facebook agirà in proprio in questa decisione) saranno temporaneamente limitate, in attesa che il fact-checking compia il proprio lavoro.

A tutto ciò Facebook aggiunge un fondo da due milioni di dollari per supportare progetti che aiutino le persone a stabilire cosa leggere e cosa condividere. Due milioni, insomma, investiti nella qualità dei contenuti che il social network veicola per mezzo della propria stessa community. Due milioni e una nuova policy, insomma, investiti sull’elemento umano: laddove gli algoritmi non possono andare, occorre investire in consapevolezza.