Immaginiamo di poter chiedere a un robot di passarci il biscotto e vederlo eseguire l’ordine senza battere ciglio. Sembra fantascienza, ma è esattamente quello che promette Helix, il nuovo modello di apprendimento automatico per robot umanoidi presentato da Brett Adcock, fondatore e CEO di Figure.

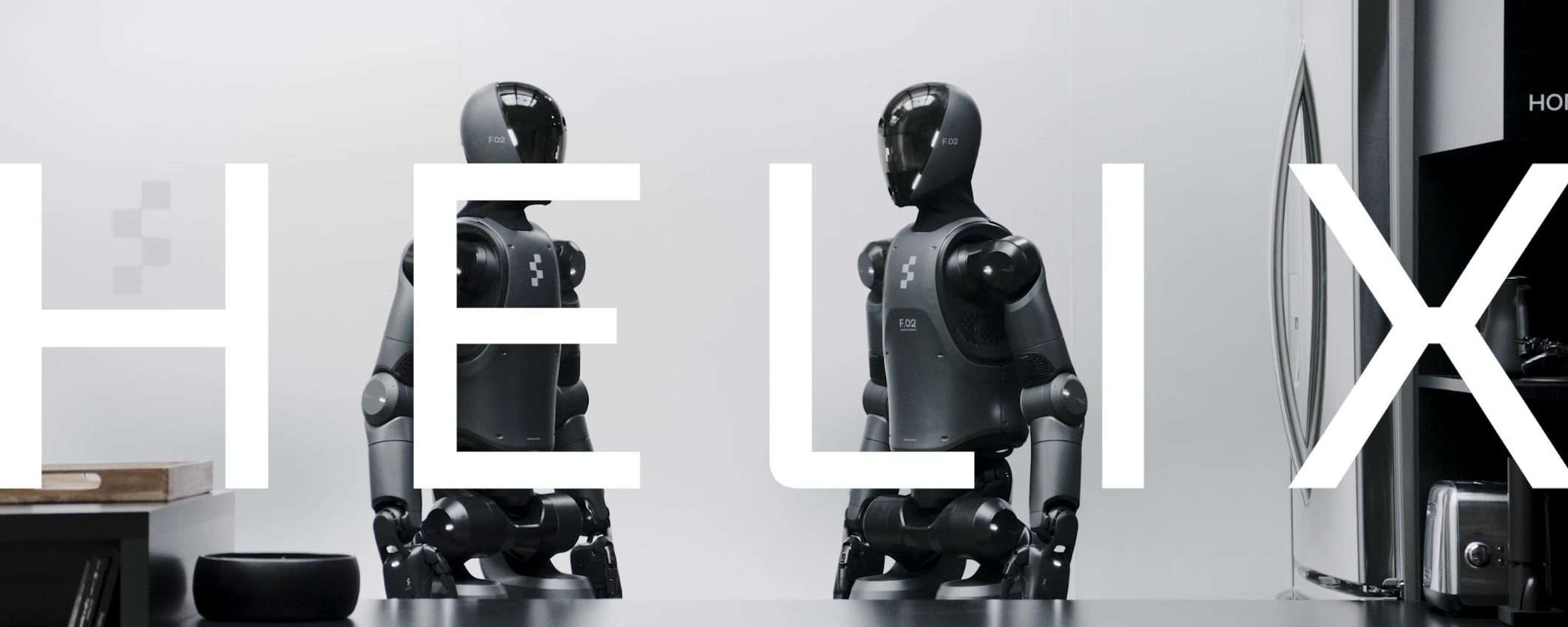

Robot di Figure obbedisce ai comandi vocali per aiutare in casa

L’annuncio arriva a due settimane dalla decisione di Figure di interrompere la collaborazione con OpenAI. Al centro della novità c’è Helix, un modello VLA (Vision-Language-Action) generalista, che combina dati visivi e prompt testuali per controllare un robot in tempo reale.

Helix funziona in modo simile a RT-2 di Google DeepMind. Dopo aver ricevuto un comando vocale in linguaggio naturale, il robot analizza visivamente l’ambiente circostante ed esegue il compito richiesto. Ad esempio, si può dire: “Prendi il sacchetto di biscotti dal robot alla tua sinistra e mettilo nel cassetto aperto“.

La particolarità di Helix è che è progettato per controllare due robot contemporaneamente, con uno che assiste l’altro nell’esecuzione di varie faccende domestiche. Figure sta infatti testando il VLM con il suo robot umanoide 02 in ambiente casalingo, notoriamente ostico per i robot vista la mancanza di struttura e uniformità tipica di magazzini e fabbriche.

Difficoltà di apprendimento e controllo sono i principali ostacoli che impediscono ai robot complessi di entrare nelle nostre case. Ecco perché la maggior parte delle aziende di robotica umanoide punta prima su clienti industriali, per migliorare l’affidabilità e abbassare i costi prima di affrontare le abitazioni.

Robot umanoidi in casa, un obiettivo lontano

Con l’annuncio di Helix, Figure chiarisce che la casa deve essere una priorità a sé stante. Insegnare ai robot a svolgere compiti complessi in cucina, ad esempio, li apre a una vasta gamma di azioni in contesti diversi. Una sfida stimolante e complessa per testare questi modelli di addestramento.

Per essere utili in casa, i robot dovranno essere in grado di generare nuovi comportamenti intelligenti su richiesta, soprattutto per oggetti mai visti prima. Insegnare loro anche un singolo nuovo comportamento richiede attualmente un notevole sforzo umano: ore di programmazione manuale a livello di esperti o migliaia di dimostrazioni.