Il mese scorso, Google ha annunciato con grande entusiasmo il lancio di Imagen 3, il suo modello AI text-to-image più avanzato fino ad oggi. Inizialmente, solo un gruppo ristretto di persone ha avuto l’opportunità di testare questo potente strumento per generare immagini, ma sembra che Big G sia pronta ad aprire le porte a un pubblico più vasto.

Quando Google ha annunciato Imagen 3 per la prima volta nel suo blog il 14 maggio, ha dichiarato che lo strumento era disponibile per alcuni creatori selezionati in anteprima privata su ImageFX e che era possibile iscriversi a una lista d’attesa. Inoltre, ha dichiarato che Imagen 3 sarebbe presto arrivato su Vertex AI.

L’accesso anticipato per gli abbonati a Gemini Advanced

Durante un’indagine sull’app Google per Android (versione beta 15.25.31.29), Android Authority ha scoperto un interessante popup attivato da un flag. L’intestazione del popup recita “First look: Imagen 3” e il testo sottostante invita gli abbonati a Gemini Advanced a provare Imagen 3 in accesso anticipato. Il popup include anche un elenco a discesa che elenca tutte le nuove caratteristiche e i miglioramenti apportati all’ultima versione dello strumento AI.

Al momento, non c’è un modo definitivo per sapere se il modello sta effettivamente utilizzando Imagen 3. Tuttavia, se le indicazioni fornite dal popup sono accurate, sembra che Google stia permettendo a un numero maggiore di utenti di sperimentare il suo nuovo generatore di immagini AI.

Imagen 3 di Google, come funziona?

La tecnologia alla base di Imagen si basa sulla generazione di immagini a partire da testo (text-to-image). Il primo passaggio prevede l’addestramento di un grande modello linguistico su un ampio dataset di testi e immagini, in modo che impari le correlazioni tra descrizioni testuali e contenuti visuali. Successivamente, quando un utente inserisce una descrizione testuale, questa viene elaborata dal modello linguistico che analizza la descrizione testuale e la trasforma in una rappresentazione vettoriale chiamata embedding.

L’embedding viene poi inviato al secondo modello AI, che utilizza una tecnica per catturare il significato semantico del testo, chiamata diffusione, per produrre l’immagine vera e propria. Fin qui il processo è simile ad altri generatori di immagini AI come Midjourney o DALL-E.

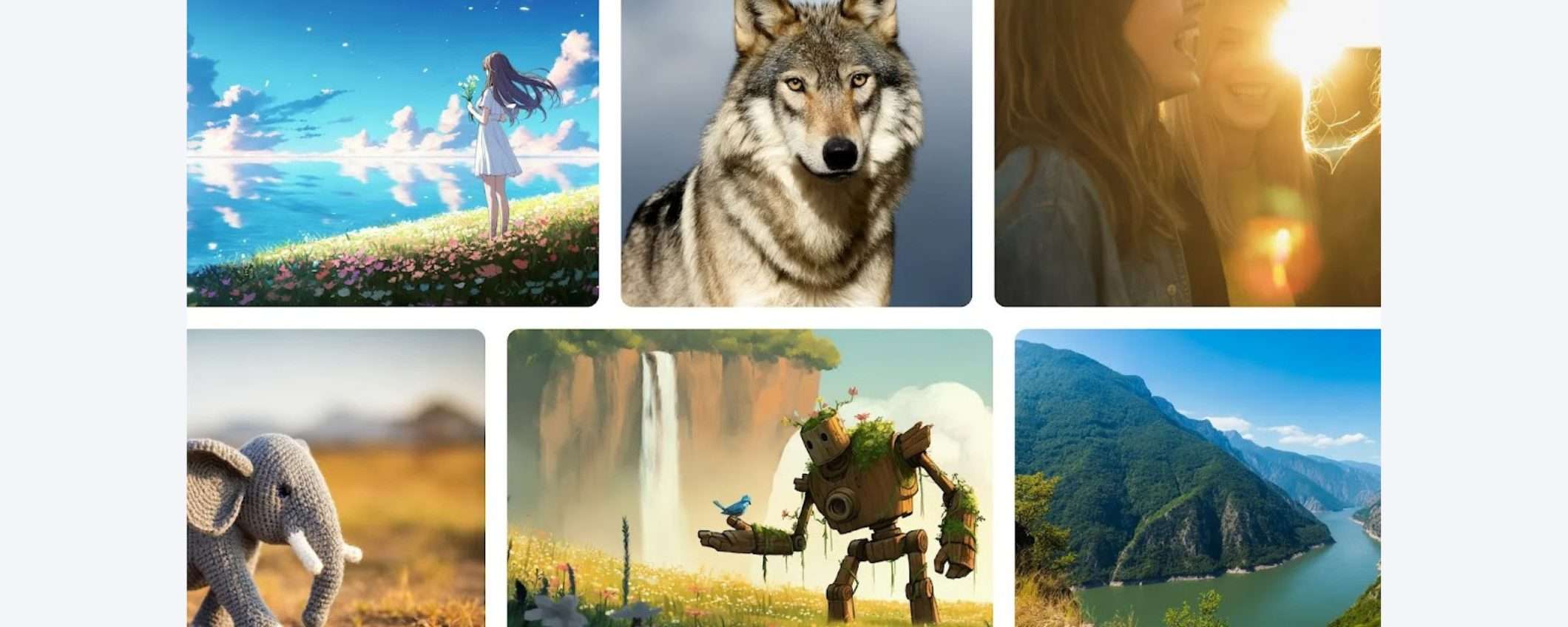

La peculiarità di Imagen sta nell’utilizzo di un ulteriore modello, addestrato appositamente a generare immagini ad alta risoluzione, con una maggiore fedeltà visiva. Inviando l’immagine preliminare e l’embedding del testo a questo modello aggiuntivo, si ottiene infine l’immagine finale, dall’aspetto più realistico e definito. È proprio questa combinazione di modelli e tecniche diversi che contraddistingue Imagen rispetto ad altri sistemi di text-to-image disponibili oggi.