Microsoft ha annunciato il lancio di Phi-3 Mini, il primo di una serie di tre modelli di piccole dimensioni che l’azienda prevede di rilasciare. Questo modello, con 3,8 miliardi di parametri, rappresenta un’evoluzione nella creazione di modelli AI più efficienti e accessibili.

Caratteristiche e prestazioni di Phi-3 Mini

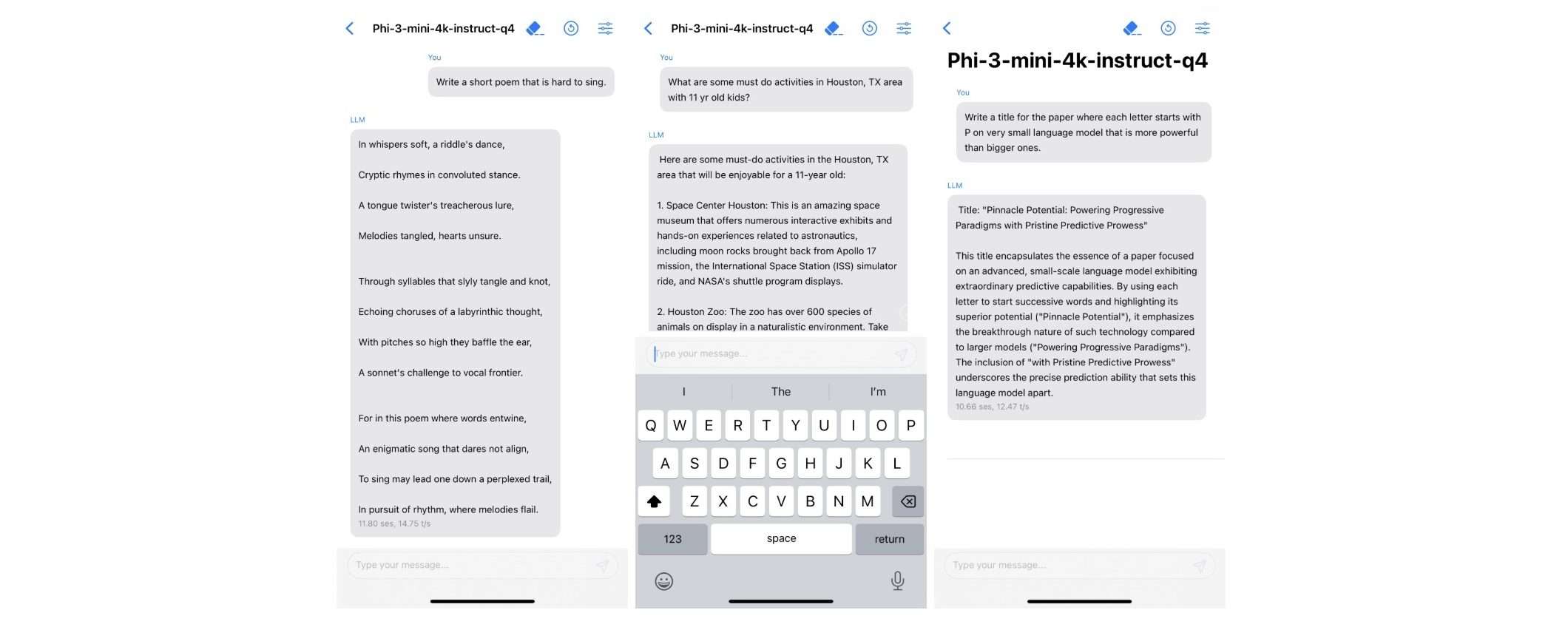

Phi-3 Mini è stato addestrato su un set di dati più piccolo rispetto a LLM come GPT-4. Tuttavia, nonostante le sue dimensioni ridotte, dimostra prestazioni notevoli. Microsoft afferma che Phi-3 offre risultati migliori rispetto alla versione precedente, Phi-2, ed è in grado di fornire risposte simili a quelle di un modello 10 volte più grande.

Eric Boyd, corporate vice president di Microsoft Azure AI Platform, ha sottolineato che Phi-3 Mini possiede le stesse capacità di GPT-3.5, ma in un formato più compatto.

I modelli di AI leggeri presentano diversi vantaggi rispetto alle loro controparti più grandi. Innanzitutto, sono più economici da gestire e funzionano in modo più efficiente su dispositivi come smartphone e computer portatili. Questo aspetto li rende particolarmente interessanti per le aziende che desiderano implementare soluzioni di AI personalizzate senza dover affrontare costi elevati o requisiti di potenza di calcolo eccessivi.

La concorrenza nel campo dei modelli AI di piccole dimensioni

Microsoft non è l’unica azienda a concentrarsi sui modelli AI di piccole dimensioni. Anche i suoi concorrenti, come Google, Anthropic e Meta, hanno sviluppato i propri modelli leggeri, ognuno con caratteristiche e destinazioni d’uso specifiche. Gemma 2B e 7B di Google eccellono nella creazione di semplici chatbot e lavori legati al linguaggio, mentre Claude 3 Haiku di Anthropic si distingue per la sua capacità di leggere e riassumere rapidamente documenti di ricerca densi di grafici. Llama 3 8B di Meta, invece, trova applicazione nella realizzazione di chatbot e nell’assistenza alla codifica.

L’approccio innovativo di Microsoft nell’addestramento di Phi-3

Boyd ha rivelato che gli sviluppatori di Microsoft hanno adottato un approccio unico nell’addestramento di Phi-3, ispirandosi al modo in cui i bambini apprendono attraverso le storie della buonanotte, libri con parole semplici e strutture di frasi che affrontano argomenti più ampi. Microsoft ha collaborato con un professore universitario per creare dei “libri per bambini” su misura per insegnare a Phi-3, utilizzando un elenco di oltre 3.000 parole.

Phi-3 rappresenta un’evoluzione naturale della famiglia di modelli Phi di Microsoft. Mentre Phi-1 si concentrava sulla codifica e Phi-2 iniziava a imparare a ragionare, Phi-3 ha perfezionato entrambe le capacità. Tuttavia, è importante notare che, nonostante quest’ultimo modello possieda alcune conoscenze generali, non è in grado di competere con modelli di grandi dimensioni come GPT-4 in termini di ampiezza delle risposte.

Tuttavia, secondo Boyd, le aziende spesso trovano più vantaggioso utilizzare modelli più piccoli come Phi-3 per le loro applicazioni personalizzate, poiché i loro set di dati interni sono comunque di dimensioni ridotte. Inoltre, grazie al minor consumo di potenza di calcolo, questi modelli risultano spesso molto più convenienti rispetto alle alternative di grandi dimensioni.