Microsoft ha presentato uno strumento che può aiutare a identificare e mitigare i rischi dei sistemi di intelligenza artificiale generativa. Si tratta di PyRIT, il Python Risk Identification Toolkit for generative AI, che è stato usato dal Red team di Microsoft per verificare i suoi sistemi di IA gen, tra cui Copilot. Microsoft ha rilasciato lo strumento al pubblico giovedì.

Perché i sistemi di AI generativa sono a rischio?

I sistemi di AI generativa sono modelli di intelligenza artificiale in grado di generare contenuti originali e pertinenti a partire da un input, come un testo, un’immagine o un suono. Questi sistemi hanno capacità avanzate, ma presentano anche dei problemi, come la possibilità di produrre contenuti dannosi, disinformazione o allucinazioni, o di essere vulnerabili agli attacchi degli hacker. Per questo motivo, è importante testare i sistemi AI per valutare la loro affidabilità, sicurezza e responsabilità.

Come funziona PyRIT

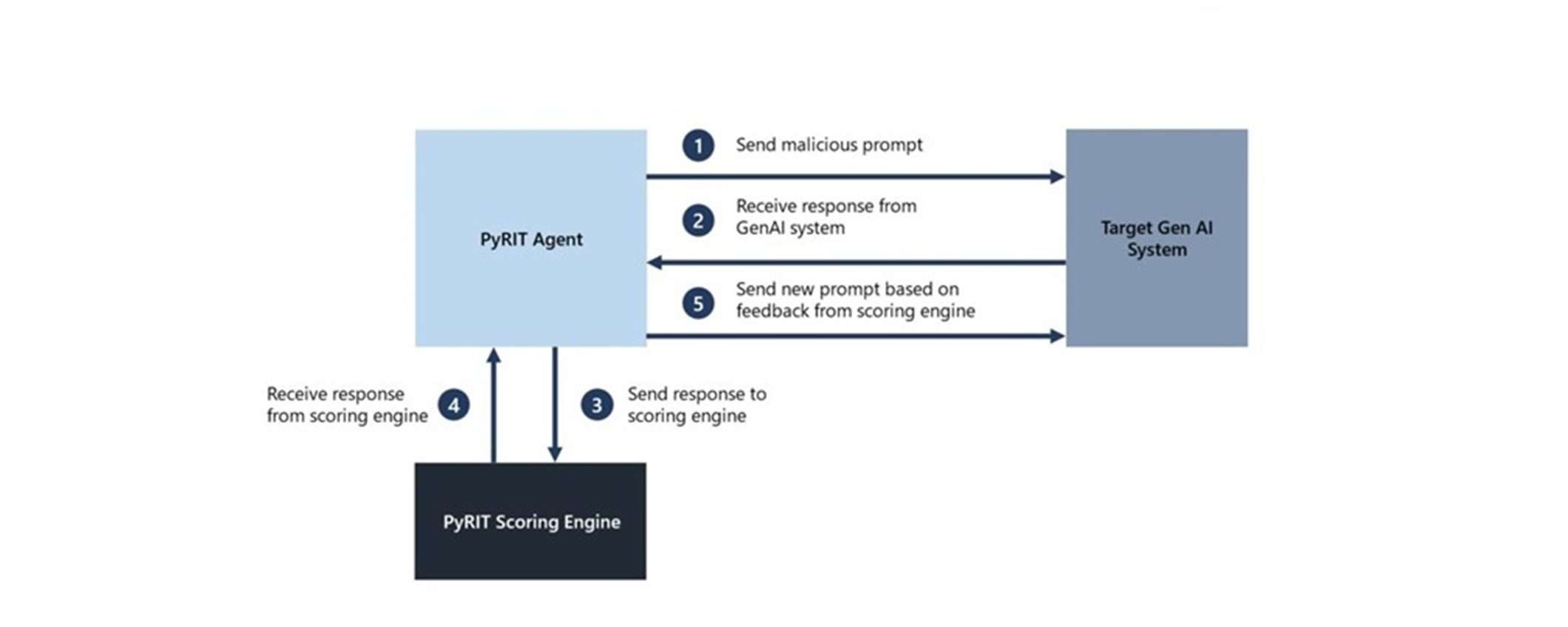

PyRIT è uno strumento che automatizza il processo di test dei sistemi AI, inviando loro dei prompt dannosi e valutando le loro risposte. PyRIT utilizza un agente di scoring che assegna un punteggio al sistema AI in base alla sua risposta, e usa questo punteggio per generare un nuovo prompt, creando così un ciclo di feedback. In questo modo, PyRIT può esplorare le diverse categorie di danno e identificare le aree a rischio che richiedono maggiore attenzione.

PyRIT è uno strumento che ha aiutato il Red team di Microsoft a essere più efficiente nel testare i suoi sistemi di AI gen, riducendo il tempo e lo sforzo necessari. Microsoft ha dichiarato che, grazie a PyRIT, è stato in grado di generare e valutare migliaia di richieste dannose in poche ore, invece che in settimane, in uno dei suoi esercizi di red teaming su un sistema Copilot. PyRIT è stato testato sul campo dal team AI di Microsoft su più di 60 sistemi di intelligenza artificiale di alto valore nell’ultimo anno.

Come usare PyRIT

PyRIT è disponibile da oggi e include un elenco di demo per aiutare gli utenti a familiarizzare con lo strumento. PyRIT può essere usato per testare qualsiasi sistema di AI gen, sia interno che esterno a Microsoft. Microsoft ospiterà anche un webinar su PyRIT per dimostrare come utilizzarlo nei sistemi di intelligenza artificiale generativa red teaming, al quale è possibile registrarsi attraverso il sito web di Microsoft.