L’intelligenza artificiale rappresenta un’enorme opportunità di progresso tecnologico e innovazione, ma comporta anche dei rischi e delle responsabilità, soprattutto quando si tratta di pubblicare risultati scientifici. Un caso emblematico è quello di un articolo sulle cellule staminali spermatiche, pubblicato da Frontiers in Cell and Developmental Biology, una rivista sottoposta a revisione paritaria.

L’articolo conteneva immagini generate dall’AI, alcune delle quali erano palesemente errate e inadeguate. Questo fatto ha sollevato un acceso dibattito sull’affidabilità dell’intelligenza artificiale e sulla necessità di processi di verifica più solidi nella ricerca scientifica.

L’errore dell’AI

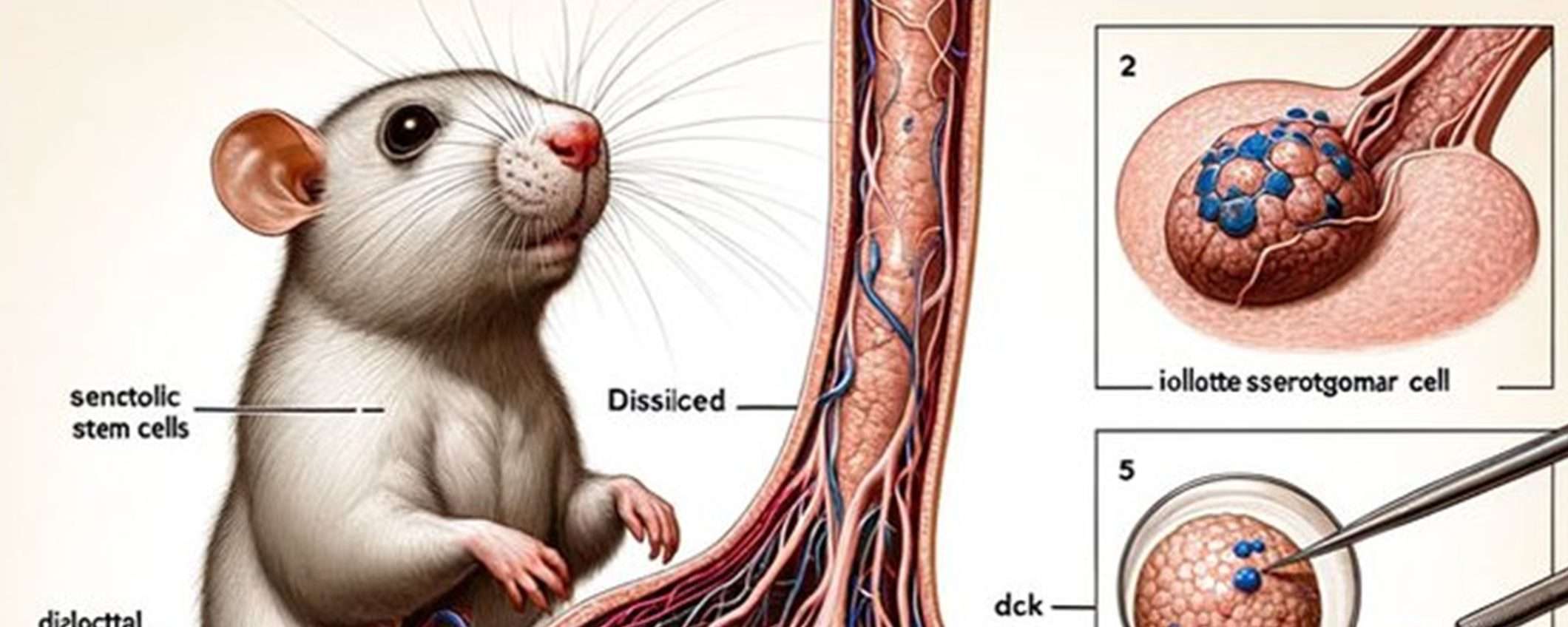

Le immagini dell’articolo incriminato erano state generate con Midjourney per illustrare i dettagli delle cellule staminali dello sperma. Tra queste spiccava per inesattezza quella di un ratto con un pene gigantesco. Le altre immagini non erano da meno, con didascalie confuse e raffigurazioni imprecise che assomigliavano più a un’opera surrealista che a illustrazioni scientifiche. Questo caso, oltre a evidenziare i rischi dell’utilizzo acritico dell’IA in ambito accademico, ha sollevato interrogativi sui processi editoriali della rivista.

Erm, how did Figure 1 get past a peer reviewer?! https://t.co/pAkRmfuVed H/T @aero_anna pic.twitter.com/iXpZ1FvM1G

— Dr Charlotte Houldcroft is on maternity leave (@DrCJ_Houldcroft) February 15, 2024

La rivista ha poi modificato l’articolo, ammettendo la necessità di un esame più approfondito del ruolo dei contenuti generati dall’AI nel mondo accademico. Questo episodio pone l’accento sulla necessità di validazione umana dei contenuti generati dall’IA prima della loro diffusione in contesti che richiedono rigore e precisione.

Il futuro dell’IA e della ricerca accademica: una coesistenza possibile

L’utilizzo di strumenti di intelligenza artificiale generativa nella ricerca e nella pubblicazione accademica è in crescita e offre potenziali vantaggi in termini di efficienza e nuove intuizioni. Tuttavia, come dimostra chiaramente la vicenda, il percorso verso una integrazione armonica tra AI e mondo accademico presenta ancora numerose sfide. Sarà essenziale introdurre processi di verifica più rigorosi e un maggiore senso critico per garantire che l’AI sia utilizzata come strumento per migliorare e non per danneggiare la qualità della ricerca.