Il mondo delle IA generative sta assistendo al continuo lancio di soluzioni mai viste prima, o aggiornamenti importanti ai modelli già esistenti, che elevano ulteriormente le capacità – e le aspettative – di tali strumenti, rendendo i loro prodotti ancora più realistici e, in fondo, preoccupanti. Nelle ultime ore, pensate, anche il CEO di Google Sundar Pichai ha evidenziato la necessità di più dibattiti con esperti di IA, filosofi e altri attori pubblici al fine di definire il destino dell’intelligenza artificiale in ogni suo caso d’uso.

Tra gli strumenti più interessanti e giudicati pericolosi da diverse realtà spicca Stable Diffusion, portato recentemente dalla versione XL da Stability AI. Questa iterazione usa 2,3 miliardi di parametri ed eccelle nel fotorealismo; ergo, è un fenomenale generatore di deepfake. Molte persone non conoscono però la sua storia, dalla nascita avvenuta lo scorso agosto alla più recente versione accessibile ai tester professionisti. Per questa ragione, vediamo cos’è Stable Diffusion e perché può essere molto pericolosa.

Cos’è Stable Diffusion?

Il modo più elementare per descrivere tale strumento è il seguente, e viene fornito dalla stessa Stability AI: è un modello che trasforma testi in immagini, permettendo a miliardi di persone di creare opere d’arte straordinarie in pochi secondi. Gli sviluppatori la definiscono “una svolta in termini di velocità e qualità”, in quanto permette la rapida generazione di quadri in pochi secondi, a patto che ci si trovi in possesso di un computer dotato di una scheda grafica particolarmente potente.

Data una serie di condizioni, dunque, Stable Diffusion democratizza la generazione di immagini offrendosi come modello generativo open source, il cui codice è accessibile a chiunque e le cui porte sono aperte al pubblico di tutto il mondo.

Non scenderemo nei minimi dettagli del funzionamento in quanto sono richieste nozioni tecniche complesse. È sufficiente sapere, però, che in seguito all’addestramento dell’IA essa può utilizzare input testuali decisi dall’utente per emettere infine un’immagine basata puramente sull’interpretazione della richiesta, la quale avviene effettuando una ricerca delle parole chiave nell’immenso database al quale ha accesso. Lo stesso ordine da parte dell’essere umano, inoltre, può generare output differenti e subire modifiche a seconda dei parametri posti dall’utente.

Le differenze con Midjourney

Rispetto a Midjourney si tratta di una soluzione apparentemente meno accessibile, prevalentemente in quanto quest’ultima IA generativa è rimasta raggiungibile mediante il server Discord a costo zero per milioni di persone. In altri termini, Midjourney è sempre stata più comoda da utilizzare rispetto a Stable Diffusion. Il progetto di Stability AI, inoltre, sembra generare immagini dalla qualità inferiore. Tuttavia, offre più possibilità di personalizzazione e controllo sia prima della generazione che in seguito ad essa.

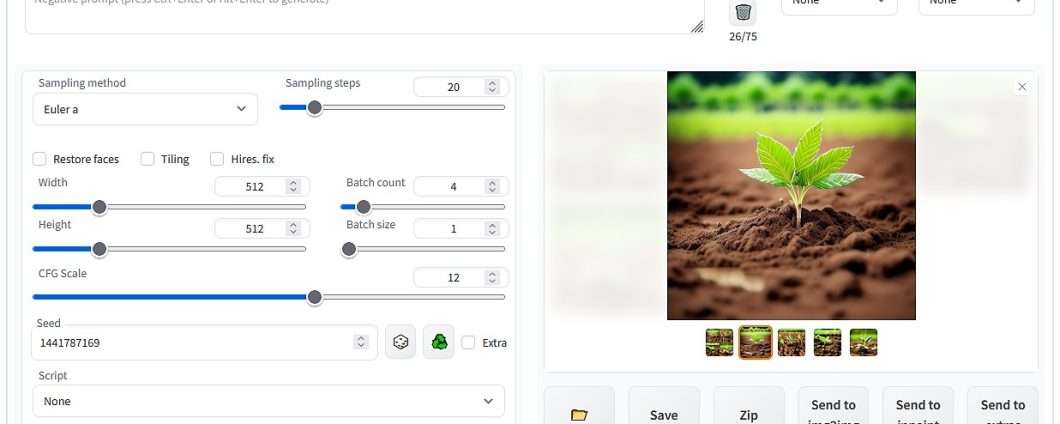

A dimostrarlo è l’interfaccia custom offerta da AUTOMATIC1111 su GitHub, basata naturalmente sul codice comunemente accessibile di Stable Diffusion. Essa mostra chiaramente la possibilità di generare un seed – in termini semplici, una stringa numerica dalla quale dare vita all’immagine – e di selezionare dettagli chiave come il numero di passaggi da seguire prima della determinazione dell’output, oppure le dimensioni della fotografia digitale finale.

In aggiunta, Stable Diffusion è completamente gratuito e si adatta a qualsiasi stile richiesto dagli utenti. Sul fronte accessibilità, però, Midjourney supera il suo rivale nonostante non sfrutti comunque un’interfaccia dedicata, bensì operi come bot su Discord.

In definitiva, la IA generativa di Stability AI si rivela nettamente superiore rispetto ai suoi rivali, restituendo più rapidamente output dalla qualità più elevata, pur richiedendo una certa dimestichezza con le interfacce utente realizzate da sviluppatori di terze parti.

Diatribe legali

Stable Diffusion non rivendica alcun diritto sulle immagini generate e concede liberamente agli utenti i diritti di utilizzo di qualsiasi prodotto generato dal modello, a condizione che il suo contenuto non sia illegale o dannoso per le persone. Il problema risiede nei database utilizzati al fine di addestrare l’IA, protetti da copyright e utilizzati senza il consenso del proprietario. Questo dettaglio ha portato infine Stability AI in tribunale: lo scorso febbraio, difatti, Getty Images (uno dei principali fornitori di immagini stock e fotografie professionali al mondo) ha intentato la seconda vertenza contro i creatori di Stable Diffusion in quanto avrebbero utilizzato 12 milioni di fotografie appartenenti alla sua libreria senza alcuna autorizzazione.

Mentre la causa procede, gli artisti hanno iniziato ad esprimersi contro l’uso diffuso di software di sintesi di immagini come questo, poiché potrebbe portare artisti umani, insieme a fotografi, modelli, direttori della fotografia e attori, a perdere gradualmente appeal rispetto alle soluzioni basate sulle intelligenze artificiali. Il dibattito sul diritto d’uso degli output forniti da Stable Diffusion è nel vivo e una soluzione sembra molto distante: si tratta, in fondo, di “acque legali” mai esplorate da alcuna nave. Ovvero, questa diatriba in tribunale costituirà uno dei precedenti legali fondamentali nella precisazione dei casi d’uso corretti delle IA generative e dei loro limiti.

Affrontando le preoccupazioni che il modello possa essere utilizzato per scopi abusivi, il CEO di Stability AI, Emad Mostaque, ha dichiarato:

“È responsabilità delle persone stabilire se il modo in cui la tecnologia viene usata è etico, morale e legale, e se consegnare Stable Diffusion al pubblico possa comportare più vantaggi netti o conseguenze negative.”

Quale sarà, dunque, il futuro di Stable Diffusion? Ora come ora è difficile rispondere a questo quesito in virtù delle cause legali ancora in corso. Una volta concluse, sarà possibile inquadrare il suo destino.