Si chiama Deepfake Detection Challenge (DFDC) e mette gli uni contro gli altri – in una competizione che è tutto fuorché una gara tra antagonisti – Microsoft, Facebook, Partnership on AI ed un lungo elenco di università americane (Cornell Tech, MIT, University of Oxford, UC Berkeley, University of Maryland, College Park). L’obiettivo è quello di unire le forze contro i pericoli del deep fake, frontiera contro cui ad oggi non ci si può che presentare disarmati sotto ogni punto di vista.

Lotta al deep fake

La sfida contro i deep fake non può essere una guerra di cortile, nel quale ognuno fa il possibile per difendere il proprio orticello, perché altrimenti si rimarrà inesorabilmente schiacciati dalla forza di malintenzionati armati di Intelligenza Artificiale. Ecco perché grandi aziende e grandi università si mettono assieme, attraverso una competizione, per capire come poter indirizzare al meglio gli sforzi contro il problema del falso.

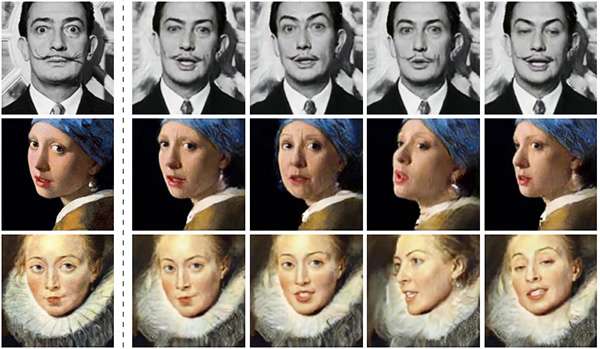

La potenziale gravità dei deep fake è stata capita dalle masse nel momento in cui i primi fake-Obama e fake-Zuckerberg sono giunti online: video apparentemente credibili di due personaggi di grande notorietà, video nei quali a questi personaggi venivano fatte pronunciare frasi mai realmente pronunciate. La qualità realizzativa del filmato rende il tutto credibile ad una mente poco attenta e poco propensa ad un atteggiamento critico, il che rende il deep fake una sfida di grandissima importanza.

Deepfake Detection Challenge

La competizione è stata costruita su basi scientifiche, affinché se ne possa uscire con vere e proprie metriche, basate su veri e propri metodi, con la possibilità di poter così gettare le basi per una ricerca collaborativa contro i filmati fasulli. Gli organizzatori descrivono lo sforzo come quello che, negli anni passati, consentì di restituire un’esperienza gradevole agli utenti utilizzanti le email: lo spam è combattuto a colpi di filtri sempre più sofisticati, sempre più ricchi e continuamente aggiornati.

Così si intende fare nella lotta al deep fake, dando inizio a quella ricerca del falso – e dei falsari – che permetta di isolare i rischi, maturare consapevolezza e ridurre il potenziale impatto della parola sbagliata messa artificiosamente sulla bocca sbagliata. La viralità, in questi casi, farebbe il resto e le conseguenze potrebbero essere deleterie: è nell’interesse di tutti capire come detronizzare il falso ed evitare che possa trovare spazi d’espressione online.

L’obiettivo della sfida è quello di produrre tecnologia che tutti possano usare per meglio identificare i casi un cui l’IA è stata usata per alterare un video al fine di imbrogliare chi lo sta vedendo.

Sebbene il falso accompagni quotidianamente le immagini fotografiche, con i video la pericolosità è di tutt’altra evidenza: non si è abituati ad osservare un video con atteggiamento critico e quel che viene documentato si tende a credere che sia giocoforza vero. Iniziare una seria lotta al deep fake prima che il deep fake possa far danni è dunque espressione di ambizione e di timore, due sentimenti che hanno consentito di far unire le forze ad un alto numero di esperti: una gara nella quale vincono tutti, utenti in primis.