Prevedere i cyberattacchi studiando i cyberattacchi, associando l’analisi di un’infinità di log effettuata a mezzo algoritmi con la valutazione degli esperti, così da addestrare il sistema a riconoscere nuovi scenari e fare in modo che le situazioni di pericolo vengano riconosciute come tali. I ricercatori del Computer Science and Artificial Intelligence Laboratory (CSAIL) del MIT, in collaborazione con la statup PatternEx, specializzata in machine learning, hanno presentato AI 2 , piattaforma in grado di combinare l’intelligenza artificiale (AI) con la cosiddetta “Analyst Intuition”, la capacità degli esperti di elaborare degli schemi ricorrenti che si associno alle anomalie.

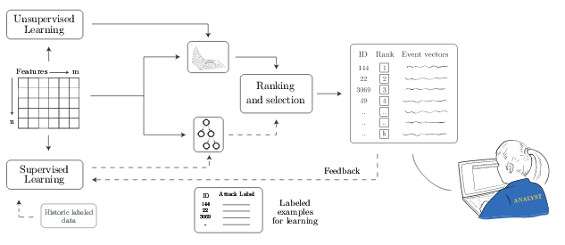

AI 2 , spiegano i ricercatori, contribuisce a prevedere i cyberattacchi analizzando grandi quantità di log web e generati dai firewall e individuando pattern significativi che caratterizzano le attività sospette: il sistema di machine learning, testato su sistemi di aziende che hanno collaborato alla ricerca, opera autonomamente nelle fasi di analisi dei dati e nelle fasi di individuazione dei pattern, basandosi su parametri incentrati sulla attività degli indirizzi IP, sulle attività associata agli utenti, sulle sessioni, aggregando dati in diversi intervalli temporali per fare emergere modelli di comportamento rilevanti e variazioni rispetto ai modelli di comportamento ordinari.

Il sistema si interfaccia poi con gli esperti di sicurezza umani, che offrono il loro feedback riguardo alla pericolosità degli eventi rilevati come attacchi. Questa compresenza del fattore umano consente all’AI di affinare le proprie rilevazioni e di elaborare nuovi modelli, così da individuare i rischi in maniera sempre più rapida ed efficiente.

AI 2 , nei test effettuati fino ad ora per un periodo di tre mesi su 3,6 miliardi di log forniti da una non meglio precisata piattaforma di e-commerce, è riuscita ad individuare l’85 per cento degli attacchi, riducendo altresì di cinque volte il numero dei falsi positivi.

In questo modo, spiega Kalyan Veeramachaneni del CSAIL, “possiamo mostrare agli analisti umani un massimo di 200 o addirittura 100 eventi al giorno, che è una piccola percentuale di quello che succede”: il contributo dei ricercatori di sicurezza umani, con la selezione a monte operata da AI 2 , viene ridotto al minimo indispensabile. Ma non è superfluo: “Gli attacchi evolvono costantemente – osserva Veeramachaneni – e abbiamo bisogno degli analisti per continuare a classificare i nuovi attacchi. Questo sistema non fa a meno degli analisti. Offre loro supporto”.

Gaia Bottà